João M.

Deep Learning Research Engineer

Han har specialiseret sig i at opbygge avancerede modeller, herunder store sprog modeller (LLMs), i stand til kode refactoring, bug detection, og kontinuerlig læring. João arbejder omfattende med PyTorch og implementerer modeller på cloud-platforme og højtydende computersystemer.

Forud for ASML, ledede han forskerhold hos GAIPS Lab, der blev offentliggjort i førende AI-konferencer og sikrede konkurrenceprægede tilskud fra USA. Luftvåben og FCT. Han har også undervist AI kurser, tjene en Teaching Excellence Award for hans bidrag til uddannelse.

João vigtigste projekter omfatter fremme løbende indlæringsteknikker, der gør det muligt for AI at erhverve ny viden uden at glemme tidligere opgaver, og anvende forstærkning læring til at uddanne modeller mere effektivt med færre data. Han brænder for at gøre AI-systemer mere effektive, praktiske, og løbende forbedre.

Hovedekspertise

Erfaring4

Deep Learning Research Engineer

- Led a research team on the "LLMs for Software Engineering" projekt, med fokus på teknisk gældsreduktion fejlregistrering, og dokumentation analyse ved hjælp af store sprogmodeller.

- Designet, implementeret, uddannet, testet, og implementeret LLMs for automatisk kode refactoring og bug detection.

- Implementerede modeller til cloud produktion miljøer og HPC distribuerede computing klynger.

- Monitored den fortsatte ydeevne af implementerede modeller ved hjælp af værktøjer såsom MLFlow, Sacred, og vægte og biaser.

- Forbundet virksomhedens forskningsafdeling med akademiske partnere på TU/e.

Deep Learning Research Engineer

- Designet, implementeret, uddannet, testet, og implementeret state-of-the-art dyb læring arkitekturer, herunder skuespiller-kritik, DQNs, og LLM'er, der anvender konvolutionelle, tilbagevendende og opmærksomhedsbaserede mekanismer til udvinding af funktioner på tværs af en lang række opgaver.

- Deployed modeller til cloud produktion miljøer på platforme som Google Cloud, Amazon AWS, og Slurm HPC distribueret computing klynger.

- Monitored den fortsatte ydeevne af implementerede modeller ved hjælp af værktøjer som MLFlow, Sacred, og vægte og biaser.

- Sammensat virksomhedens HPC Slurm klynge.

- Led fem forskerhold som første forfatter, offentliggøre et forskningsdokument for hver i top-tier AI spillesteder, herunder AAAI, IJCAI, ECAI, den kunstige efterretningstjeneste og PLoS One Journal.

- Præsenteret AI-forskning på førende internationale konferencer som AAAI, IJCAI og ECAI.

- Sikrede to konkurrencemæssige finansieringstilskud, en fra USA Air Force Office of Scientific Research og en anden fra den portugisiske fond for videnskab og teknologi (FCT).

- Modtaget den bedste papir pris for projektet “Hjælpe folk på flue: Ad Hoc Teamwork for Human-Robot Teams.”

Software Engineer

- Reduceret teknisk gæld og øget samlet testdækning af Top Sky Tower-løsningen, et værktøj for flyveledere til at styre elektroniske strimler.

- Implementeret og testet kritiske sikkerhedsdetekteringssystemer.

Software Engineer

- Uddannet et Convolutional Neural Network til at klassificere gyldige identitetskort billeder.

- Implementeret software til automatiske og periodiske sikkerhedskopier af universitetets optegnelser til AWS cloud.

- Reimplementeret ældre software ved hjælp af moderne teknologier som Scala og Kotlin.

Vurderinger

Ingeniørmæssig fremragendehed

João samlede præstation i en 90-minutters teknisk vurdering i realtid er blandt de top 5% bedst kontrollerede Deep Learning Research Engineer hos Proxify.

Portefølje

Fremhævet af João

1

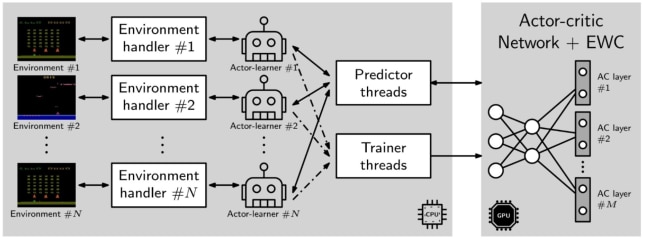

1This project investigates two hypothesis regarding the use of deep reinforcement learning in multiple tasks. The first hypothesis is driven by the question of whether a deep reinforcement learning algorithm, trained on two similar tasks, is able to outperform two single-task, individually trained algorithms, by more efficiently learning a new, similar task, that none of the three algorithms has encountered before. The second hypothesis is driven by the question of whether the same multi-task deep RL algorithm, trained on two similar tasks and augmented with elastic weight consolidation (EWC), is able to retain similar performance on the new task, as a similar algorithm without EWC, whilst being able to overcome catastrophic forgetting in the two previous tasks. We show that a multi-task Asynchronous Advantage Actor-Critic (GA3C) algorithm, trained on Space Invaders and Demon Attack, is in fact able to outperform two single-tasks GA3C versions, trained individually for each single-task, when evaluated on a new, third task—namely, Phoenix.

We also show that, when training two trained multi-task GA3C algorithms on the third task, if one is augmented with EWC, it is not only able to achieve similar performance on the new task, but also capable of overcoming a substantial amount of catastrophic forgetting on the two previous tasks.

Andre projekter 3

Uddannelse

Stop med at søge.

Bliv matchet hurtigere.

Tal med en ekspert og få skræddersyede matches fra vores netværk på kun 2 dage.

Få adgang til over 6.000+ eksperter

Få matchet med en udvikler på gennemsnitligt 2 dage

Ansæt hurtigt og nemt med 94 % matchsuccess